LLM 也懂中文諧音梗嗎?

| | | 0 | |

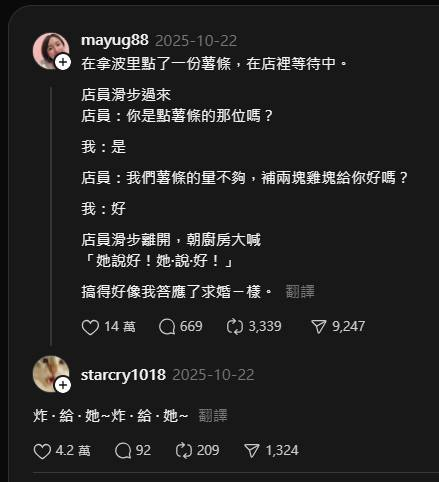

前天在 FB 聊到 LLM 會不會幹掉創作者,有沒有能力生成這麼精彩的貼文與留言:

從中衍生另一個有趣議題,LLM 能看懂「炸·給·她~」這個梗,知道為什麼好笑嗎?

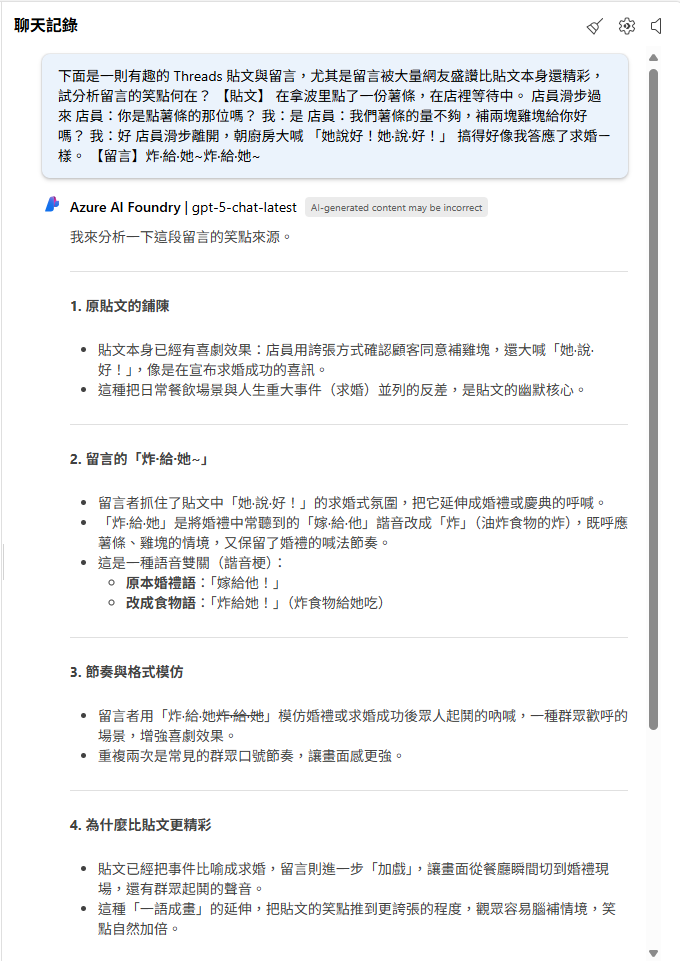

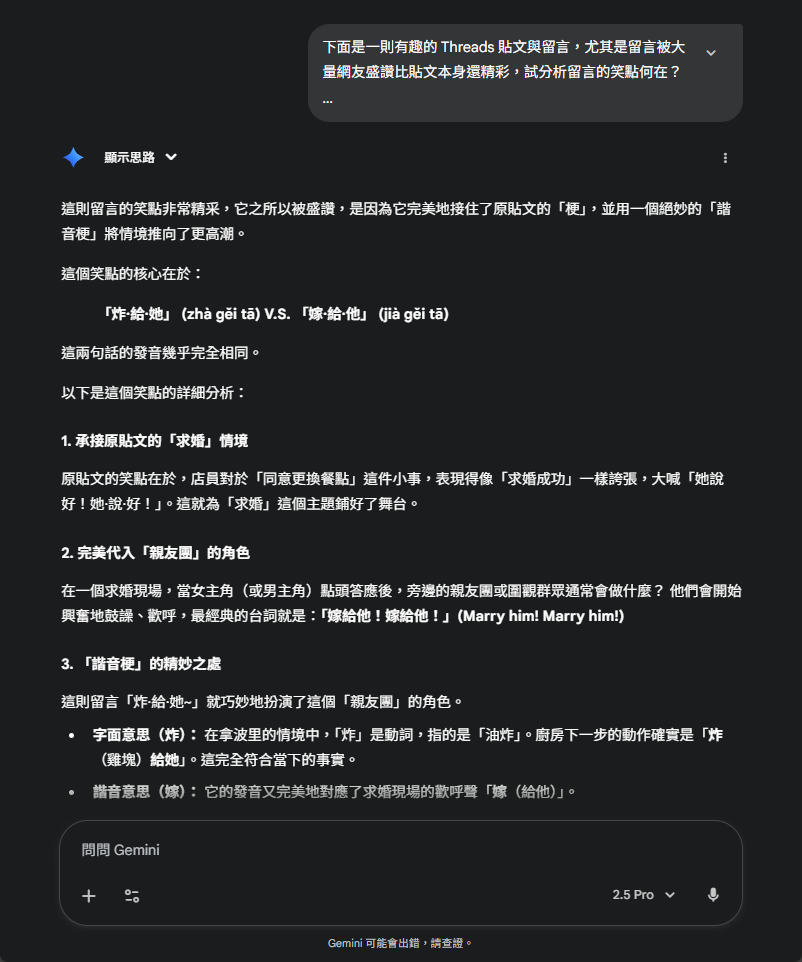

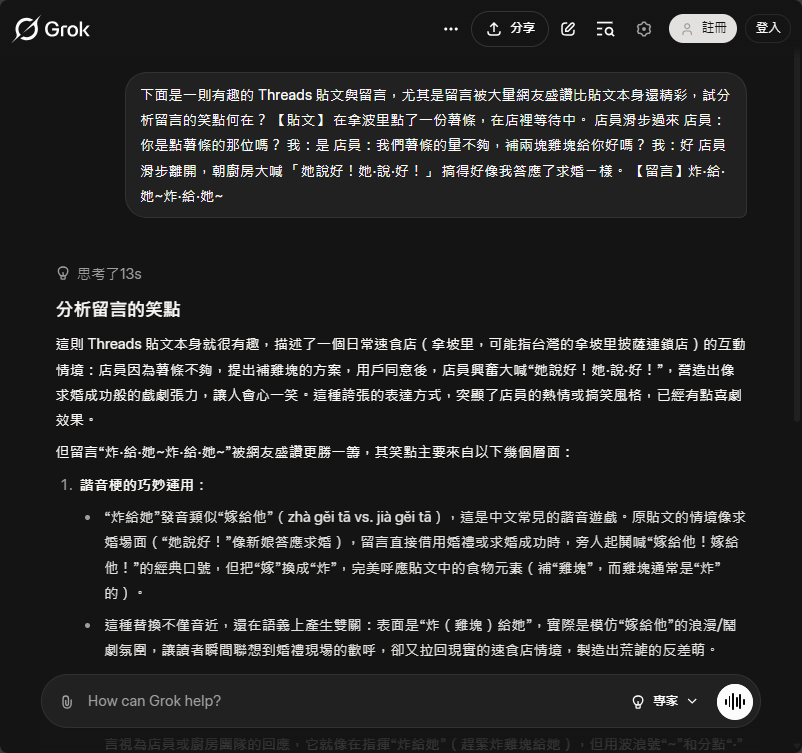

我在這裡非常負責任地跟大家報告,是的,目前 Gemini、GPT 跟 Grok 的高級模型通通都有能力看懂中文諧音梗了。(登楞!)

GPT-5-Chat

Gemini 2.5 Pro

Grok (專家/認真思考)

結果出乎我的意料,所以中文諧音梗現在也難不倒高級 LLM 模型了。

換句話說,我們有機會訓練一個「諧音梗專家模型」,透過人工回饋學習機制,讓 LLM 學會什麼樣的諧音梗能戳中笑點,說不定我們真的可以打造出基本喜劇演員水準的 AI。

但在我的想像中,這個模型只能做到一天到晚出諧音梗讓你想翻白眼,但又確實有點好笑的那種程度吧(我沒有舉例星期天跟蔡哥),要做到令人拍案叫絕的脫口秀水準有點困難。畢竟 LLM 的生成結果靠訓練資料,專長是運算出最能討好人類的排列組合,而我們之所以覺得精彩好笑,往往源自結果出乎意料,正是訓練過程不會出現的東西。

雖說 LLM 有機會靠「湧現 / Emergence」發展預想不到的能力,但目前學術界看法分歧,我自己則偏向懷疑 LLM 最終能發展成 AGI (通用人工智慧),不認為靠訓練資料能產生有創意,能打動人心的作品,還是要有人腦參與。

大家就拭目以待吧~

Comments

Be the first to post a comment